OpenAI publica estudo delineando novo modelo para geração de imagens

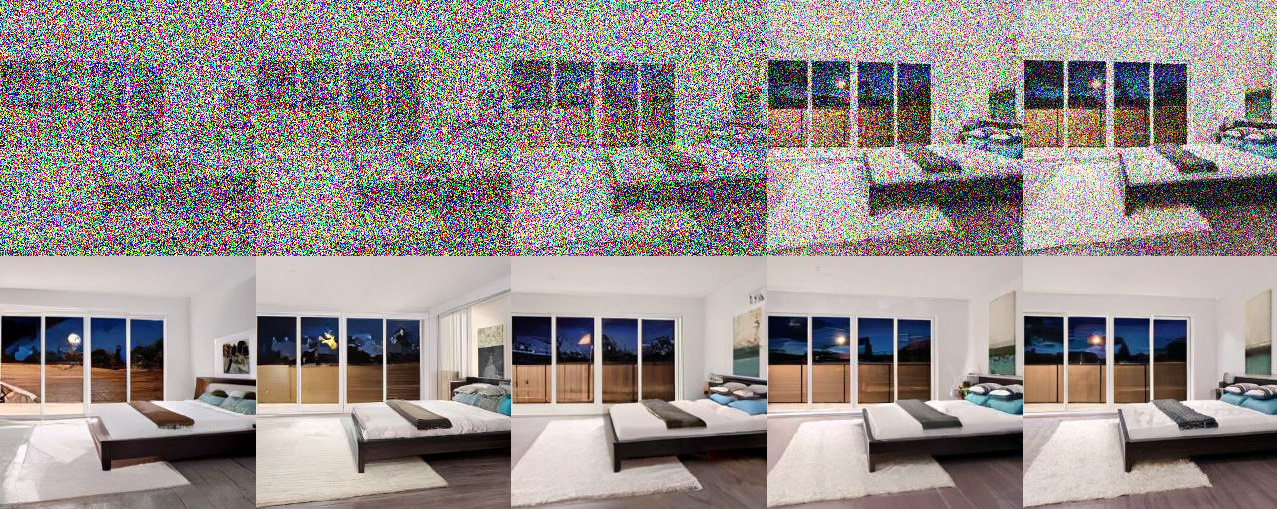

Enquanto modelos de difusão – como os utilizados no DALL-E e Stable Diffusion – são treinados para subtrair ruídos em milhares de etapas até chegar a um resultado satisfatório, o “modelo de consistência” faz isso em uma única etapa, tornando-se ordens de magnitude mais rápido e eficiente, possibilitando sua execução em dispositivos como smartphones.

Mesmo quando a imagem é composta principalmente por ruído ou dados, os modelos de consistência vão direto para o resultado final.